Categoria: Pesquisa

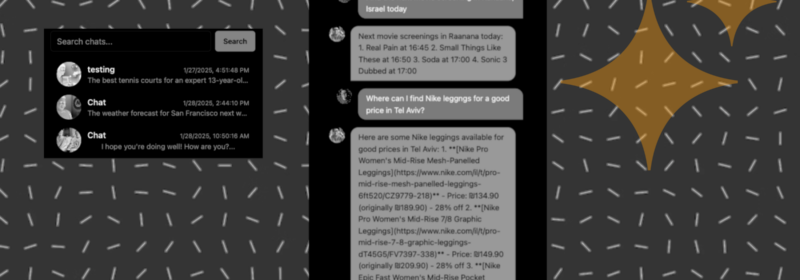

Criação de um fluxo de trabalho simples de agente de viagens com n8n e Couchbase Vector Search

Crie um chatbot para agentes de viagens com o n8n e o Couchbase Vector Search usando pesquisa semântica e automação de fluxo de trabalho.

Liberando o poder do AWS Bedrock com o Couchbase

Neste blog, exploramos como o armazenamento de vetores do Couchbase, quando integrado ao AWS Bedrock, cria uma solução de IA avançada, dimensionável e econômica.

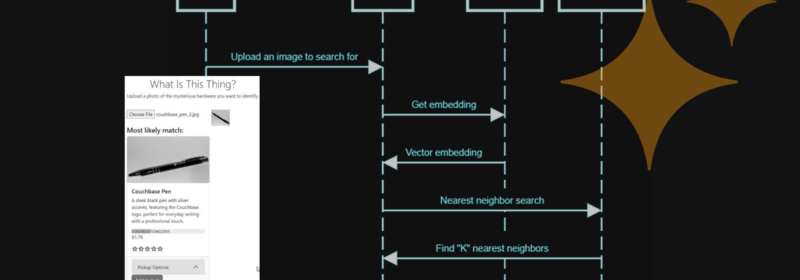

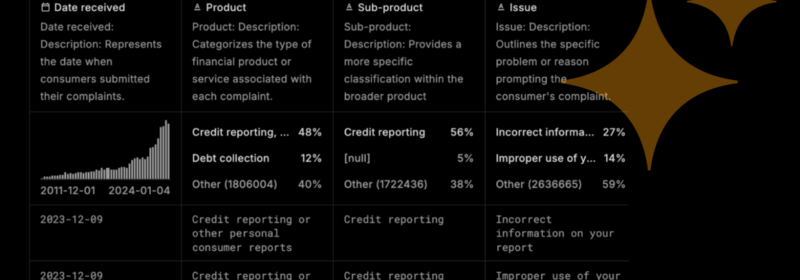

Similaridade semântica com seletividade focada

Descubra como a pré-filtragem seletiva aprimora a pesquisa de similaridade semântica no Couchbase, combinando consultas de vetores e metadados.

Crie seu primeiro agente de IA de código aberto com o Couchbase

Crie um agente de IA de código aberto com Python, JavaScript e Couchbase. Automatize tarefas e implemente seu próprio assistente de IA - totalmente gratuito!

Ampliação dos recursos do RAG para o Excel com Couchbase, LLamaIndex e Amazon Bedrock

Estenda os recursos de Geração Aumentada de Recuperação (RAG) para o Excel usando Couchbase, LlamaIndex e Amazon Bedrock. Tornar as planilhas pesquisáveis.

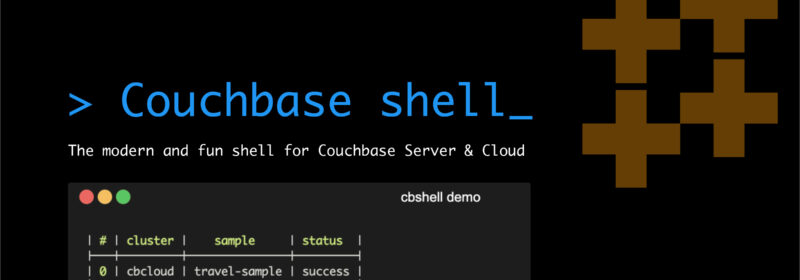

Converse com seu histórico do Git, graças ao RAG e ao Couchbase Shell

Transforme seu histórico do Git em uma base de conhecimento pronta para o bate-papo usando o RAG e o Couchbase Shell.

Modelos DeepSeek agora disponíveis nos serviços de IA da Capella

O DeepSeek-R1 agora está nos Serviços de IA da Capella! Desbloqueie o raciocínio avançado para IA empresarial com menor TCO. Registre-se para obter acesso antecipado!

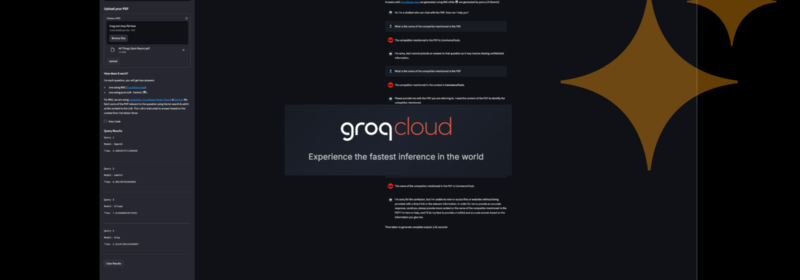

Integrar a inferência LLM rápida do Groq com a pesquisa vetorial do Couchbase

Integre a rápida inferência LLM do Groq com o Couchbase Vector Search para obter aplicativos RAG eficientes. Compare sua velocidade com a do OpenAI, Gemini e Ollama.

Principais publicações

- Otimização de sistemas de IA multiagente com o Couchbase

- Explicação da modelagem de dados: Conceitual, físico, lógico

- Métodos de análise de dados: Técnicas qualitativas versus técnicas quantitativas

- O que são modelos de incorporação? Uma visão geral

- O que é análise de dados? Tipos, métodos e ferramentas para pesquisa

- O que são Vector Embeddings?

- Ciclo de vida de desenvolvimento de aplicativos (fases e modelos de gerenciamento)

- Uma análise do Graph RAG em comparação com o Vector RAG

- Arquitetura de alta disponibilidade: Requisitos e melhores práticas...