Etiqueta: LLMs

Liberte a IA agêntica em tempo real com agentes de streaming no Confluent Cloud e no Couchbase

Estamos entusiasmados com a parceria com a Confluent hoje, quando eles anunciam os novos recursos do Streaming Agents no Confluent Cloud e um novo mecanismo de contexto em tempo real.

Criação de agentes de IA prontos para produção com o Couchbase e o Nebius AI (recapitulação do webinar)

Essa combinação de LLM, mais as ferramentas, a memória e os objetivos é o que dá aos agentes a capacidade de fazer mais do que apenas gerar texto.

Liberando o poder do AWS Bedrock com o Couchbase

Neste blog, exploramos como o armazenamento de vetores do Couchbase, quando integrado ao AWS Bedrock, cria uma solução de IA avançada, dimensionável e econômica.

Apresentando o servidor MCP (Model Context Protocol) para o Couchbase

Apresentamos o Couchbase MCP Server: uma solução de código aberto para potencializar os agentes de IA e os aplicativos GenAI com acesso em tempo real aos seus dados do Couchbase.

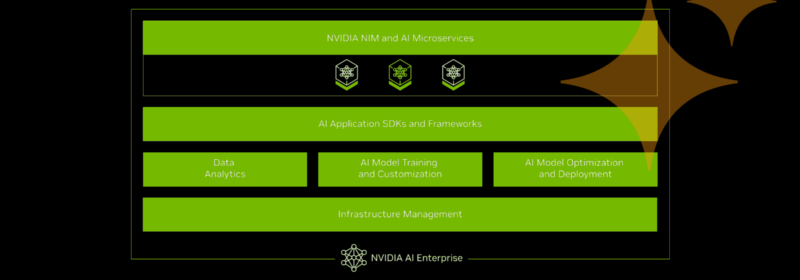

Couchbase e NVIDIA se unem para ajudar a acelerar o desenvolvimento de aplicativos agênticos

O Couchbase e a NVIDIA se unem para tornar os aplicativos agênticos mais fáceis e rápidos de criar, alimentar com dados e executar.

Modelos DeepSeek agora disponíveis nos serviços de IA da Capella

O DeepSeek-R1 agora está nos Serviços de IA da Capella! Desbloqueie o raciocínio avançado para IA empresarial com menor TCO. Registre-se para obter acesso antecipado!

Uma ferramenta para facilitar sua transição do Oracle PL/SQL para o Couchbase JavaScript UDF

Converta UDFs de PL/SQL para JavaScript sem problemas com uma ferramenta alimentada por IA. Automatize a migração do Oracle PL/SQL para o Couchbase com alta precisão usando ANTLR e LLMs.

Integrar a inferência LLM rápida do Groq com a pesquisa vetorial do Couchbase

Integre a rápida inferência LLM do Groq com o Couchbase Vector Search para obter aplicativos RAG eficientes. Compare sua velocidade com a do OpenAI, Gemini e Ollama.

Serviço de modelo Capella: Seguro, escalável e compatível com OpenAI

O Capella Model Service permite que você implemente modelos de IA seguros e dimensionáveis com compatibilidade com OpenAI. Agora em pré-visualização privada!

Principais publicações

- Explicação da modelagem de dados: Conceitual, físico, lógico

- O que são modelos de incorporação? Uma visão geral

- Métodos de análise de dados: Técnicas qualitativas versus técnicas quantitativas

- O que é análise de dados? Tipos, métodos e ferramentas para pesquisa

- Ciclo de vida de desenvolvimento de aplicativos (fases e modelos de gerenciamento)

- O que são Vector Embeddings?

- Vector Database Use Cases: Search, RAG, and AI Apps

- Comparação entre normalização de dados e desnormalização

- Arquitetura de alta disponibilidade: Requisitos e melhores práticas...