A maioria das demonstrações de IA parece impressionante por 30 segundos e, em seguida, deixa uma pergunta sem resposta: como você realmente construiria isso?

Este é diferente.

Nesta postagem, construiremos um aplicativo de IA multimodal simples, porém eficaz, para fazer upload de uma foto de rosto e retornar as principais correspondências de celebridades em milissegundos. Por baixo dos panos, o aplicativo usa embeddings de rosto locais, Couchbase Capella Vector Search e um backend leve FastAPI para transformar uma imagem em um vetor pesquisável e recuperar as correspondências mais próximas em tempo real.

É uma demonstração divertida na superfície. Mas para os desenvolvedores, ela demonstra um padrão importante:

entrada não estruturada → geração de embedding → recuperação de vetores → resultados filtrados

Esse mesmo padrão aparece na verificação de identidade, detecção de fraudes, busca visual, personalização e correspondência de ativos de mídia.

Por que esta demonstração é importante para os desenvolvedores

Este aplicativo não é apenas “IA para diversão”. É um exemplo prático de como construir pesquisa multimodal sem precisar unir um banco de dados vetorial separado, um repositório de metadados e um pipeline de sincronização.

Com uma imagem carregada, o aplicativo:

- Detecta um rosto localmente

- Gera um embedding de 512 dimensões

- Envia esse vetor para o Couchbase

- Executa uma busca de similaridade em mais de 12.000 embeddings de rostos de celebridades

- Retorna as 3 correspondências mais próximas com pontuações

O resultado é simples para os usuários: envie uma foto → obtenha correspondências com celebridades de topo.

O resultado para desenvolvedores é mais útil: Uma arquitetura de referência limpa para busca de similaridade de imagens em tempo real.

O que o aplicativo faz

O aplicativo pega uma imagem de rosto e a compara com um conjunto de dados de 'embeddings' de celebridades.

Capacidades atuais

- Detecção de rosto e geração de embedding usando InsightFace

- Busca em tempo real por vizinhos mais próximos com Couchbase Vector Search

- Filtragem por gênero

- Ranqueamento dos top-k resultados

- Suporte para 12.094 imagens de 100 celebridades

Isso torna a experiência do usuário simples, mas o design subjacente é relevante para a produção.

Como funciona

Converter uma imagem em uma vetor

Esta demonstração utiliza o InsightFace búfalo_l modelo para extrair um embedding de rosto da imagem enviada. Esse embedding é uma representação numérica densa do rosto.

Em termos práticos, o vetor captura características como geometria facial, espaçamento, proporções e padrões estruturais. Rostos semelhantes produzem vetores que estão próximos em espaço vetorial.

|

1 2 3 4 5 |

from insightface.app import FaceAnalysis model = FaceAnalysis(name="buffalo_l") faces = model.get(image) embedding = faces[0].embedding |

Isso entrega um vetor de 512 dimensões para o rosto detectado.

2. Armazene embeddings com metadados

Cada rosto de celebridade é armazenado como um documento no Couchbase, com metadados e embedding no mesmo registro.

|

1 2 3 4 5 6 7 |

{ "type": "celebrity_face", "celebrity_id": 4, "celebrity_name": "Shah Rukh Khan", "gender": "male", "embedding": [0.023, -0.045, 0.089, ...] } |

Isso é importante porque permite que desenvolvedores mantenham campos estruturados e dados vetoriais juntos, em vez de dividi-los em vários sistemas.

3. Executar busca por similaridade de vetores

Assim que o embedding da consulta é gerado, o aplicativo realiza uma busca por vizinhos mais próximos contra o índice de vetores no Couchbase.

|

1 2 3 4 5 6 7 8 9 |

{ "knn": [ { "field": "embedding", "vector": [...512 floats...], "k": 3 } ] } |

O banco de dados retorna as correspondências mais próximas classificadas por similaridade. Como o índice de vetores e os metadados vivem juntos, você também pode combinar similaridade com filtros como gênero, região ou categoria.

Visão geral da arquitetura

O sistema é intencionalmente simples:

Navegador → FastAPI → InsightFace (inferência local) → Couchbase Capella Vector Search → Resultados

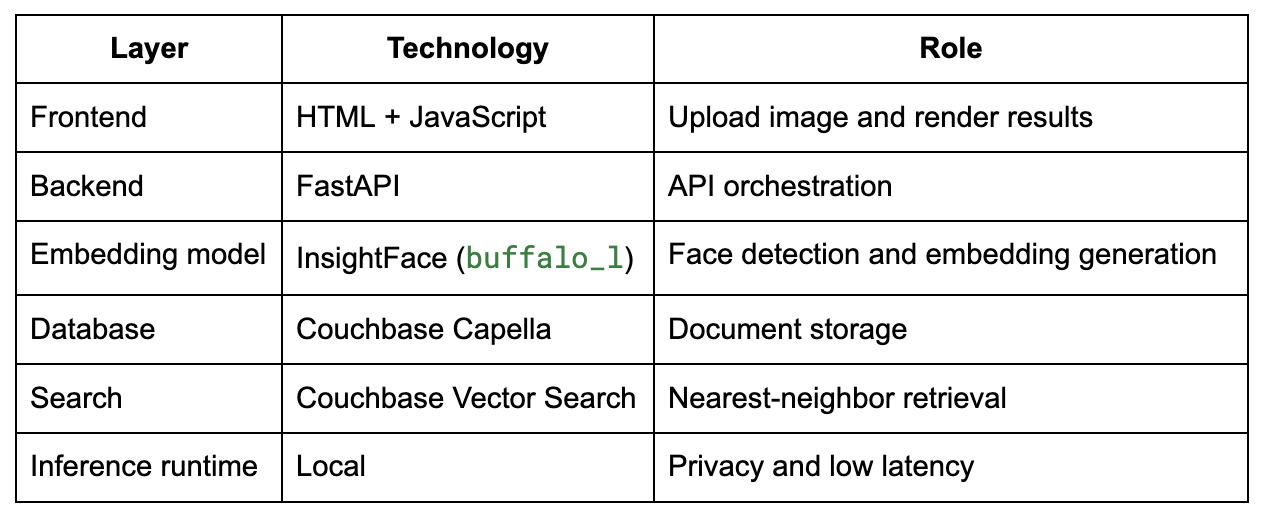

Pilha

Por que a inferência local ajuda

Para esta demonstração, a geração de embeddings faciais é executada localmente em vez de chamar um endpoint de modelo remoto.

Isso traz dois benefícios imediatos:

- Menor latência porque a imagem não precisa ir e voltar para um serviço de inferência hospedado

- Melhor postura de privacidade porque a imagem bruta pode permanecer local durante a geração de embeddings

Para desenvolvedores, este é um padrão de design importante. Nem todo fluxo de trabalho de IA multimodal precisa enviar conteúdo bruto do usuário para um serviço remoto antes que a recuperação comece.

Por que o Couchbase é uma boa opção

Este aplicativo fica muito mais limpo porque o Couchbase pode lidar com dados em documentos e pesquisa vetorial em um só lugar.

1. Vetor e metadados convivem

Em vez de gerenciar um sistema para embeddings e outro para dados da aplicação, o embedding é armazenado diretamente dentro do documento.

Isso remove uma fonte comum de arrasto arquitetural:

- Nenhuma store de vetores extra

- Sem duplicação de dados

- Sem empregos de sincronização entre metadados e embeddings

- Nenhuma camada de recuperação separada para manter

2. A recuperação híbrida é integrada

Aplicações reais raramente fazem apenas “busca de similaridade pura”. Elas geralmente precisam de uma combinação de similaridade semântica e filtragem estruturada.

Por exemplo:

- Encontre os 3 melhores jogos entre celebridades femininas

- Pesquisar dentro de uma categoria ou região específica

- Retornar rostos semelhantes apenas de um subconjunto de documentos dado

Este padrão híbrido é o que transforma uma demonstração em um primitivo de aplicação real.

3. Infraestrutura gerenciada reduz o atrito

Com o Capella, os desenvolvedores não precisam gastar tempo configurando e ajustando outro serviço especializado para testar ou entregar busca vetorial.

Isso significa mais tempo gasto com:

- Experiência do usuário

- Lógica de classificação

- Fluxos de trabalho de aplicativos

- Integração de produção

- Menos tempo gasto em infraestrutura de encanamento

Configuração do índice

Para este projeto, o índice vetorial está configurado com:

- Nome do índice: índice_de_rosto_de_celebridade

- Dimensões: 512

- Métrica de similaridade: Produto escalar

- Tamanho do conjunto de dados: 12.094 documentos

- Abordagem de recuperação: Vizinho Mais Próximo Aproximado (ANN)

Como os embeddings são normalizados, o produto escalar serve como uma medida de similaridade eficaz para recuperação de correspondência mais próxima.

Mais do que um aplicativo divertido: padrões reais de negócios

O conceito de “gêmeo de celebridade” é apenas uma embalagem amigável ao consumidor para um padrão de arquitetura sério.

Em sua essência, este é um fluxo de trabalho de recuperação multimodal:

imagem → incorporação → busca por similaridade → resultado classificado

O mesmo fluxo de trabalho pode dar suporte a uma variedade de casos de uso empresariais.

Verificação de identidade e detecção de fraudes

Serviços financeiros e sistemas de integração digital podem comparar uma selfie com uma imagem de documento de identidade, detectar duplicatas e sinalizar tentativas prováveis de personificação.

Padrão: Busca por similaridade facial em grandes bancos de dados de identidade.

Varejo e personalização

Plataformas de varejo e beleza podem usar similaridade visual para recomendar produtos, estilos ou experiências curadas com base em recursos relacionados à aparência.

Padrão: Personalização e descoberta baseadas em imagem.

Mídia e entretenimento

Estúdios e equipes de conteúdo podem pesquisar em bancos de dados de talentos, detectar ativos duplicados, organizar arquivos ou encontrar correspondências visuais para fluxos de trabalho de casting e produção.

Padrão: Recuperação de ativos que reconhece rostos.

Casos de uso de segurança e conformidade

Em ambientes regulamentados, a similaridade de imagens pode ser usada em fluxos de trabalho rigidamente controlados onde correspondência, verificação e auditabilidade são importantes.

Padrão: Recuperação de alto volume com controles de política.

Para desenvolvedores

Este projeto mostra que a busca vetorial não é mais apenas uma capacidade experimental acoplada a uma demonstração de IA. Ela está se tornando um primitivo de aplicação central.

Com uma pilha relativamente pequena, você pode:

- Gerar embeddings localmente

- Armazene vetores juntamente com metadados

- Realizar busca ANN em tempo real

- Combinar similaridade com filtros estruturados

- Envie uma experiência multimodal sem adicionar infraestrutura desnecessária

A conclusão: A experiência da partida com celebridades é o que atrai. O valor real é a arquitetura.

Considerações finais

Se você está construindo aplicações de IA que precisam pesquisar imagens, textos ou outros dados não estruturados, a parte difícil geralmente não é gerar o embedding. A parte difícil é operacionalizar a recuperação de forma limpa dentro da pilha da aplicação.

É aqui que o Couchbase ajuda.

Ao combinar armazenamento de documentos e pesquisa vetorial em uma única plataforma, os desenvolvedores têm um caminho mais simples do protótipo à produção.

E é sobre isso que esta demonstração realmente trata: não apenas encontrar seu sósia famoso, mas mostrar como a busca vetorial multimodal pode ser construída de forma rápida, prática e pronta para aplicações reais.

Para explorar o código, confira Aplicativo "Adivinhe Seu Gêmeo Celebridade".