Etiqueta: langchain

Integración de la inferencia LLM rápida de Groq con la búsqueda vectorial de Couchbase

Integra la rápida inferencia LLM de Groq con Couchbase Vector Search para aplicaciones RAG eficientes. Compara su velocidad con OpenAI, Gemini y Ollama.

Del concepto al código: LLM + RAG con Couchbase

Aprende a construir un motor de recomendación de IA generativa usando LLM, RAG e integración con Couchbase. Guía paso a paso para desarrolladores.

Los nuevos avances de Couchbase Capella impulsan el desarrollo

Impulse el desarrollo basado en IA con las últimas actualizaciones de Capella: análisis en tiempo real, búsqueda vectorial en el borde y un nivel gratuito para empezar rápidamente.

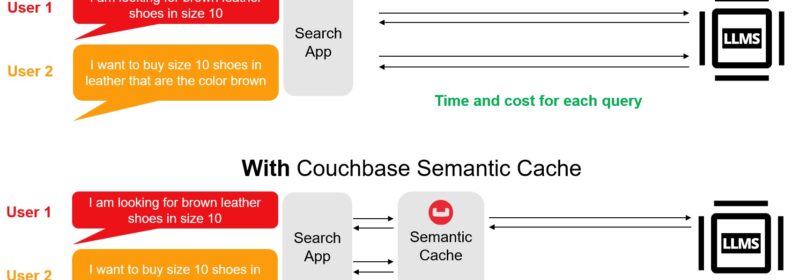

Cree aplicaciones LLM más rápidas y baratas con Couchbase y LangChain

El paquete LangChain-Couchbase integra la búsqueda vectorial, la caché semántica y la caché conversacional de Couchbase para flujos de trabajo de IA generativa.

Empieza a usar Couchbase Vector Search en 5 minutos

Tanto la búsqueda vectorial como la búsqueda de texto completo son métodos utilizados para buscar en colecciones de datos, pero funcionan de forma diferente y se adaptan a distintos tipos de datos y casos de uso.

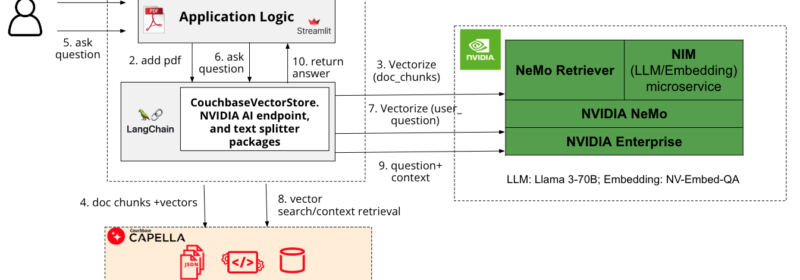

Aceleración de la aplicación de IA RAG basada en Couchbase con NVIDIA NIM/NeMo y LangChain

Desarrollar una aplicación GenAI interactiva con respuestas fundamentadas y relevantes utilizando RAG basado en Couchbase Capella y acelerarla utilizando NVIDIA NIM/NeMo.

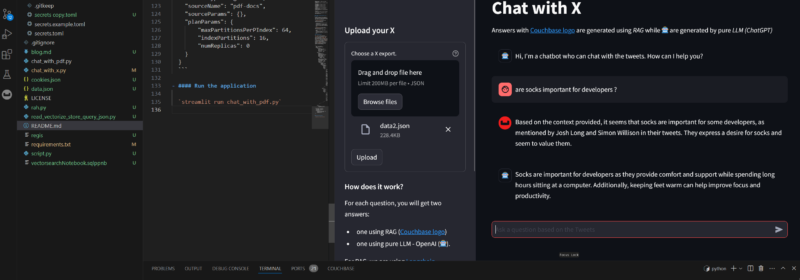

Twitter Thread tl;dr ¿Con IA? Parte 2

Construir una aplicación Streamlit que utiliza LangChain y Vector Search para datos JSON tomados de Twitter e indexados en la base de datos NoSQL Couchbase para Chat interactivo.

Top Posts

- Capella AI Services: Build Enterprise-Grade Agents

- Explicación del modelado de datos: Conceptual, físico y lógico

- Smarter Search With Graph Queries on Document Data

- Métodos de análisis de datos: Técnicas cualitativas frente a cuantitativas

- ¿Qué son los modelos de incrustación? Una visión general

- Ciclo de vida del desarrollo de aplicaciones (fases y modelos de gestión)

- ¿Qué es el análisis de datos? Tipos, métodos y herramientas para la investigación

- ¿Qué son las incrustaciones vectoriales?

- Arquitectura de alta disponibilidad: Requisitos y buenas prácticas...