Skalierbare AI-Suche

Hyperscale-Vektorindex für Daten in Milliardenhöhe und ideal für RAG-, Agenten- und Empfehlungsanwendungen.

Mit Couchbase 8.0 können Entwickler schneller als je zuvor vom Konzept zur Produktion von KI übergehen. Sie können schnelle KI-gestützte Anwendungen mit riesigen Datensätzen zu niedrigen TCO erstellen, schnell mit natürlichsprachlichen Abfragen beginnen und mit neuen Tools zur Fehlerbehebung schnelle Abfragen sicherstellen.

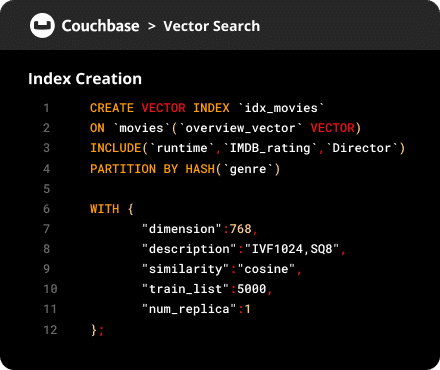

Abfragen in natürlicher Sprache mit SQL++-Erweiterungen.

Suchen Sie mit vom Entwickler definierten Synonymen, um die Suche zu vereinfachen.

Integriertes Workload-Repository und Einblicke in die Leistung.

Kompatibel mit gängigen AI-Frameworks.

Verbesserung der operativen Exzellenz durch intelligenteres Cluster-Management, erweiterte Sicherheitsfunktionen, dynamisches Rebalancing und schnelleres Failover für kontinuierliche Serviceverfügbarkeit.

Die sofort einsetzbare native Verschlüsselung im Ruhezustand macht die Daten sicherer und das Leben einfacher.

Dynamische Anpassung von Nicht-KV-Diensten ohne Hinzufügen oder Entfernen von Knoten, wodurch Verzögerungen beim Neuabgleich vermieden werden.

Aggregieren Sie Informationen aus der Telemetrie Ihres SDK-Clients für eine verbesserte End-to-End-Überwachung und eine schnellere Fehlerbehebung.

Auto-Failover von nicht reagierenden Datenknoten zur Verbesserung der Betriebszeit der Anwendung. Servieren von Anfragen während der Aufwärmphase der Caches.

It supports billions of vectors with millisecond retrieval speeds using a DiskANN-based design.

Verschlüsselung im Ruhezustand, KMIP-Schlüsselverwaltung und Ereignisüberwachung gewährleisten Datenintegrität und Compliance.

Ja. Verwenden Sie den Suchvektorindex für hybride vektorielle und lexikalische Abfragen.

Automatic failover, rebalancing, and faster startup ensure continuous operations.

Durch die Überprüfung der Couchbase 8.0 Ankündigungs-Blog.

Hyperscale hilft bei RAG-ähnlichen Anwendungsfällen, wenn Sie nicht vorhersehen können, was eine Eingabeaufforderung einen LLM fragen wird, während Composite Vector Indexes Vorfilterungsparameter verwenden, um die Vektoren einzugrenzen, die in eine Eingabeaufforderung aufgenommen werden sollen. Beide bieten Antwortzeiten im Millisekundenbereich, so dass die RAG-Workflows nicht verlangsamt werden.

Erzielen Sie hohe Leistung und Genauigkeit im Milliardenmaßstab für KI-Agenten, RAG-Workflows, kontextbezogene Speicher und Empfehlungssysteme - vor Ort oder in Capella.