信頼できるAIとエージェント

データセキュリティとAIの精度に関する懸念に対処するため、Couchbaseは、お客様がその環境内でデータとAIモデルを安全に共存させることを可能にします。組み込みのガードレールと高度な制御がアプリケーションを保護し、エージェントカタログが重要な境界付近のエージェントの動作を監視し、浮上させます。.

スケール・スピード

エージェントやAIアプリケーションは、最適なユーザーエクスペリエンスのために、多様なデータへの迅速なアクセスを必要とします。Couchbaseのアーキテクチャは、サイロ化されたデータベースの非効率性を排除し、様々なデータタイプやユースケースでミリ秒単位のレスポンスを実現します。速度をさらに向上させるために、セマンティックキャッシングは、不要なLLMの呼び出しを最小限に抑え、推論時間とコストの両方を削減します。.

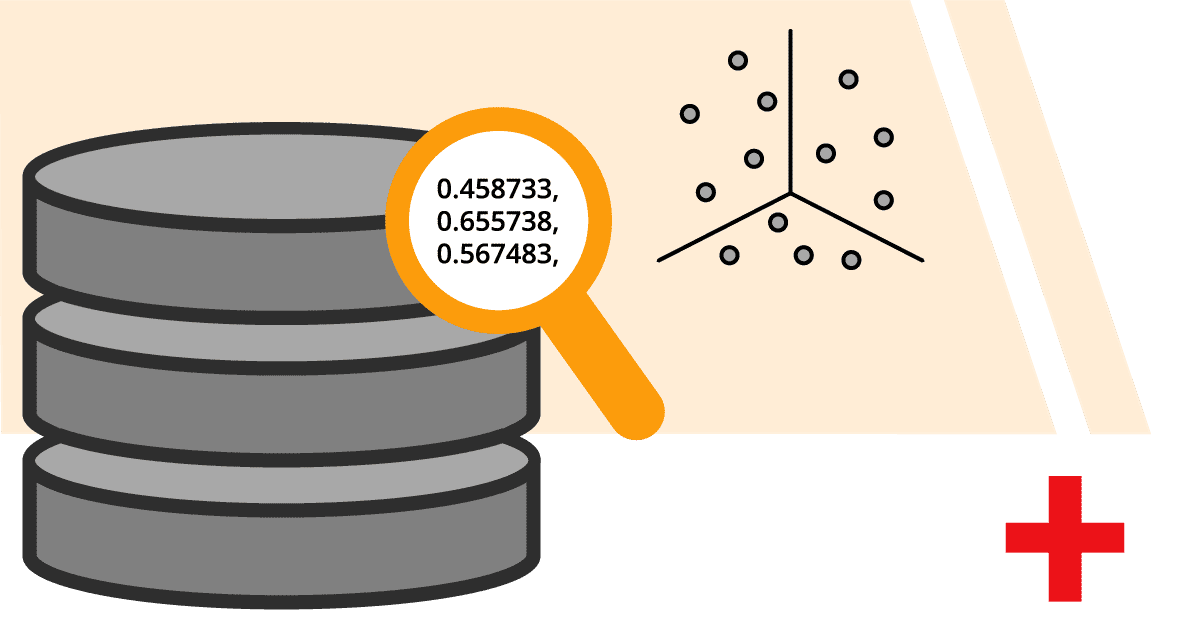

強力なベクトル検索

Couchbaseの高度なベクトル検索は、卓越したパフォーマンスと精度で10億スケールのストレージと検索を実現します。テキスト、画像などのリッチなコンテキストを可能にし、スケーラビリティ、セキュリティ、シームレスなAIツール統合により、費用対効果の高いLLMインタラクションを実現します。あらゆるユースケースに対応する10億スケールの容量と3つのインデックスオプションにより、プロトタイプから本番環境へ容易に移行できます。.

RAGパイプラインの自動化

組織はAIモデルを強化できる非構造化データを見落としがち。RAGはモデル応答を改善します。Couchbaseはデータの取り込み、ベクトル化、インデックス作成を自動化し、ワークフローを合理化し、モデル応答を改善します。非構造化データ(テキスト、PDF、画像など)をJSONとベクトルに変換し、更新に応じて自動的にベクトル化し直し、モデルにより多くのコンテキストを与えます。.

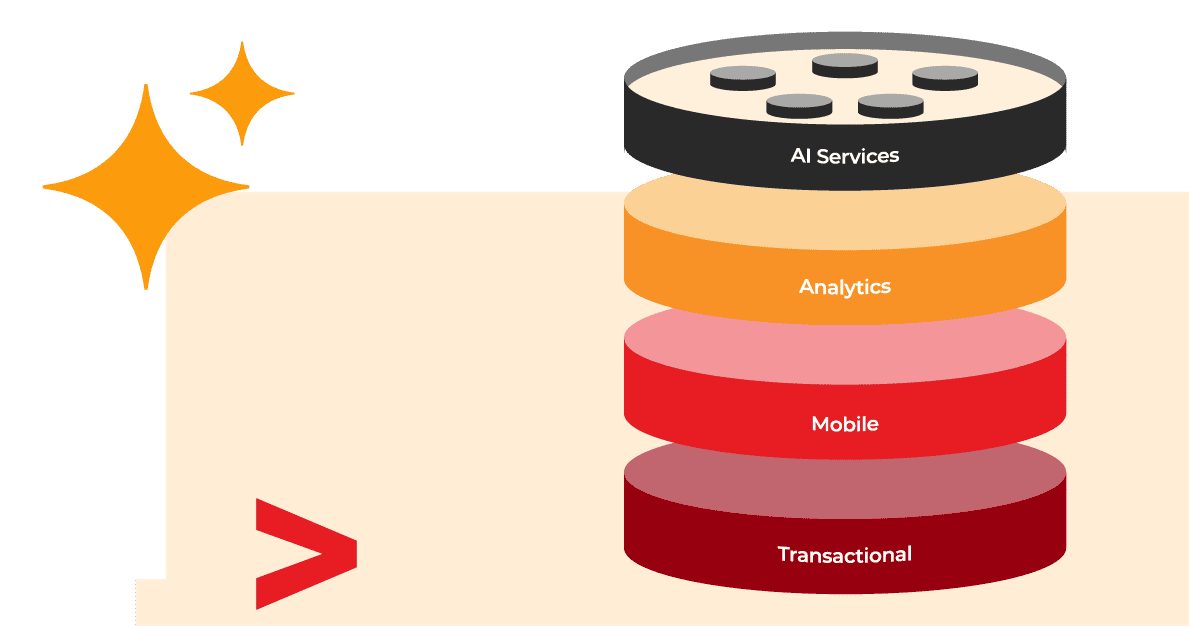

AIデータベース・プラットフォーム

Capellaはお客様の重要なAIアプリケーションとエージェントの基盤です。Capellaはお客様をサポートします:

- すべてのLLMインタラクションについて、エージェントの入力と出力を保存し、処理する。

- ガードレールを構築し、文脈記憶を管理することで、エージェントが幻覚を見ることなくタスクに集中できるようにする。.

- カペラのコンテンツ・キャッシング、高性能ベクトル検索、セマンティック・キャッシング、パフォーマンス・チューニングを利用して、AI交換のコストを削減しましょう。.

- AIとのインタラクションをモバイルユーザーに近づけることで、卓越したエクスペリエンスを実現します。

Capellaなら、パフォーマンス、規模、汎用性、コスト、グローバルな展開に妥協はありません。

お客様の声

AI services FAQ

Get quick answers to questions about AI services, security, and more.

-

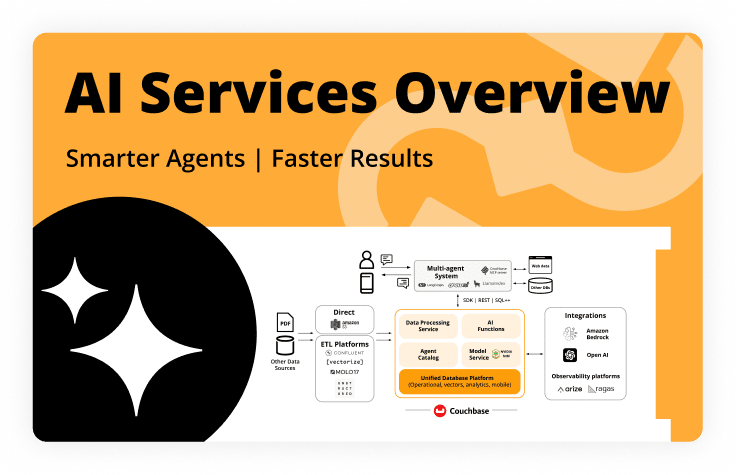

What are Couchbase AI Services?

Couchbase AI Services simplify building agentic AI by integrating vector search and model hosting into Capella. This “platform-first” approach reduces complexity across the AI lifecycle.

-

How do AI Services help with RAG?

These services automate RAG with data chunking, embedding, indexing, and semantic retrieval. Co-locating vectors with operational data ensures AI agents have real-time access to enterprise context.

-

How does Couchbase address AI trust and security concerns?

Couchbase keeps sensitive data within a controlled perimeter, preventing data outflows to external LLMs. The Agent Tracer provides visibility into AI decisions while masking private information.

-

What does the Couchbase agent catalog do?

The Agent Catalog is a hub for managing and versioning AI prompts and tool definitions. It uses semantic retrieval to select relevant tools, improving agent accuracy and lowering token costs.

-

How do AI Services reduce the cost of running AI at scale?

These services consolidate the AI stack, eliminating the fees and overhead of multiple standalone vendors. Semantic caching and native SQL++ AI functions cut costly API calls and compute cycles.